Caso guiado

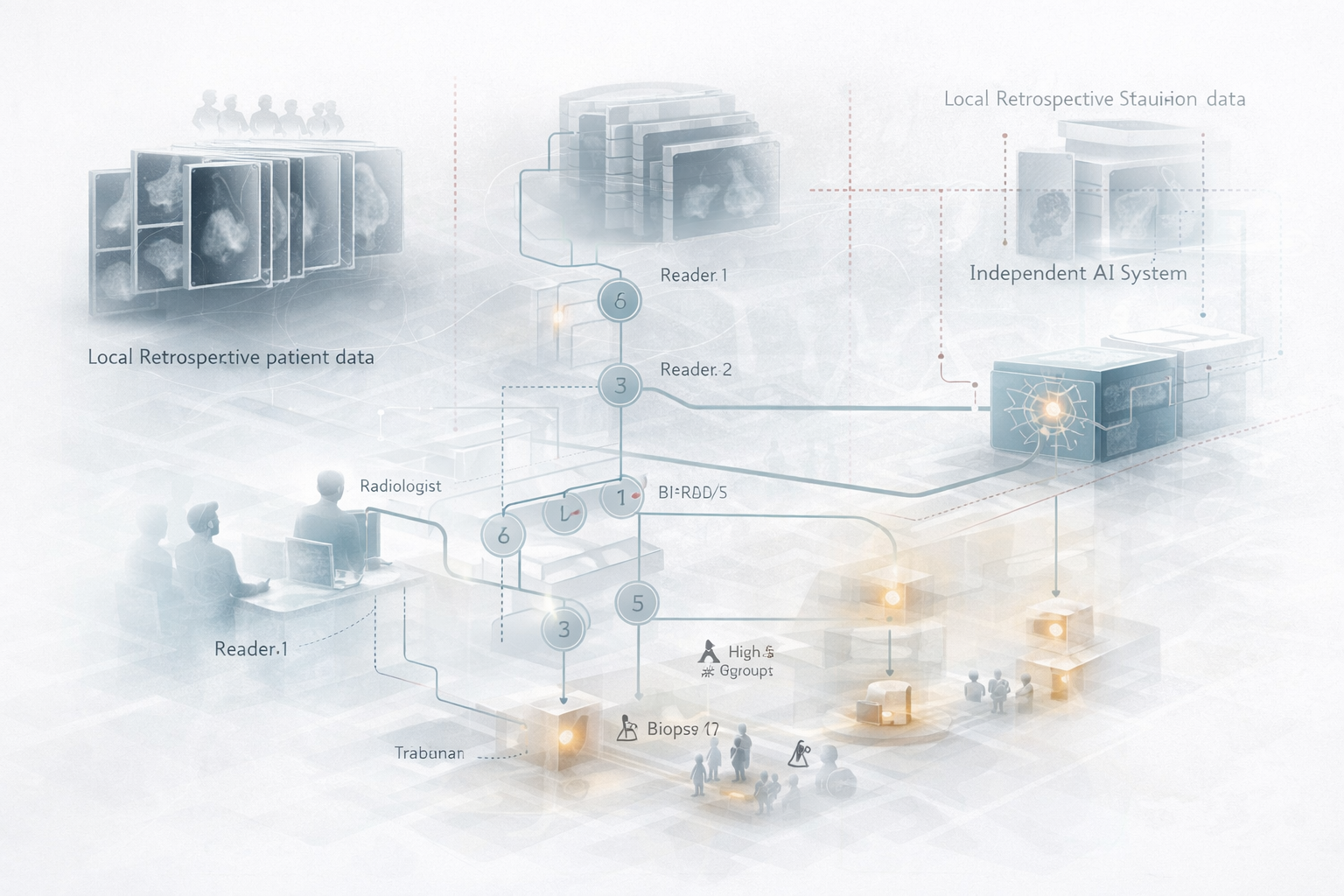

Caso guiado: IA en mamografía y retrospectivo local

Cómo usar un retrospectivo local con BI-RADS, biopsias y lectores conocidos para diseñar un flujo de IA que reduzca carga sin degradar la calidad del cribado.

Este caso es muy útil porque obliga a distinguir varias cosas que a menudo se mezclan demasiado deprisa cuando se habla de IA en mamografía. No basta con decir que el algoritmo funciona bien en general. Queremos saber si, sobre una colección retrospectiva local, puede ayudarnos a reducir la carga de lectura de los radiólogos sin perder calidad técnica ni rendimiento clínico.

Y aquí el matiz clave no es secundario: suponemos que el sistema de IA no ha entrenado con ese retrospectivo local. Ese punto es decisivo. Si el retrospectivo local ya estuviera contaminado por el entrenamiento, la evaluación perdería buena parte de su valor como ensayo de implantación real.

1. Escenario

Tenemos un retrospectivo local de mamografía con varias piezas valiosas:

- estudios ya adquiridos;

- categorías BI-RADS;

- radiólogos que los leyeron;

- biopsias o verificaciones posteriores cuando las hubo;

- y, idealmente, seguimiento suficiente para identificar parte de los falsos negativos e incluso cánceres de intervalo.

Lo que queremos no es usar la IA como adorno ni como sustituto mágico. Queremos diseñar un flujo retrospectivo que nos permita responder una pregunta concreta:

¿puede la IA reducir carga de lectura radiológica sin degradar el rendimiento clínico del programa?

2. Independencia respecto al entrenamiento

Aquí está el punto más importante del caso.

No basta con que el modelo sea comercial o que tenga buenas cifras publicadas. Para que el retrospectivo local sirva de verdad como evaluación de implantación, necesitamos asumir y documentar que:

- el algoritmo no entrenó con esa colección local;

- no hay solapamiento de pacientes, estudios o derivados obvios;

- y, en la medida de lo posible, tampoco hay una contaminación indirecta seria por reutilización del mismo conjunto como parte del desarrollo.

Ese requisito encaja además con una de las ideas centrales de las buenas prácticas de aprendizaje automático en dispositivos médicos: los conjuntos de entrenamiento y test deben mantenerse independientes, y además hay que vigilar factores de paciente, adquisición y centro para preservar esa independencia.1

Si ese matiz falla, el retrospectivo local deja de parecerse a una prueba de implantación y se parece más a una repetición complaciente del entorno donde el modelo ya aprendió.

3. Valor del retrospectivo local

Supongamos que el sistema no ha visto ese retrospectivo local. Aun así, no deberíamos dar por hecho que su rendimiento será el mismo que en la publicación del fabricante o en otro programa de cribado.

La colección local importa porque cambian muchas cosas:

- equipos y versiones;

- parámetros de adquisición;

- compresión;

- población atendida;

- densidad mamaria;

- prevalencia local;

- estilos de lectura;

- reglas de recall;

- y mezcla entre mamografía 2D y tomosíntesis, si existe.

La literatura reciente lo deja bastante claro: la IA en mamografía puede comportarse de forma distinta según cohorte, flujo y condiciones de adquisición, y los parámetros técnicos también afectan de manera no idéntica a IA y radiólogos.23

Por eso este caso no trata solo de “validar un algoritmo”. Trata de ver si un algoritmo aguanta el hospital real donde quieres desplegarlo.

4. Limitaciones del retrospectivo hospitalario

Aquí aparece otra lección práctica muy importante: una cosa es decir “tenemos retrospectivo” y otra muy distinta es tener un retrospectivo realmente utilizable para una validación seria.

Un hospital puede disponer de muchas mamografías almacenadas y, aun así, no tener resuelto lo que de verdad hace falta:

- acceso ordenado a los estudios;

- correspondencia limpia entre imagen y BI-RADS;

- lectores identificables o al menos tipificados por circuito;

- biopsias enlazadas de forma trazable;

- seguimiento suficiente para detectar parte de los falsos negativos;

- identificación de cánceres de intervalo, si el sistema puede capturarlos;

- y consistencia suficiente entre equipos, épocas y centros.

Además, la realidad local suele incluir problemas muy poco románticos:

- PACS difíciles de extraer;

- informes no estructurados;

- cambios de protocolo con el tiempo;

- mezcla de 2D y tomosíntesis;

- derivaciones externas con verdad clínica incompleta;

- y restricciones de gobernanza, anonimización o acceso al dato.

Por eso esta fase rara vez consiste en “enchufar algo y ya”. Muchas veces empieza mucho antes, en tareas de limpieza, enlace, gobierno del dato y reconstrucción mínima de la historia clínica y radiológica que permita evaluar el caso con seriedad.

5. Métricas y pregunta clínica

Si el objetivo es reducir carga de radiólogos sin perder calidad, la métrica aislada del modelo no basta. Lo que interesa es el comportamiento del equipo humano-IA dentro de un flujo concreto.

Las preguntas buenas son cosas como estas:

- ¿cuántos estudios podrían salir de segunda lectura?;

- ¿qué pasa con la sensibilidad si apartamos los casos de riesgo muy bajo?;

- ¿cuántos recalls evitamos?;

- ¿cuántas biopsias benignas bajan o suben?;

- ¿qué pasa con los cánceres de intervalo, si podemos capturarlos por seguimiento?;

- ¿cómo cambia la carga del arbitraje?;

- y qué subgrupos salen peor parados?

Esto coincide muy bien con lo que subraya la propia FDA en GMLP: no basta con la cifra del modelo en abstracto; importa la representatividad del conjunto, la independencia respecto al entrenamiento y el rendimiento del equipo humano-IA en condiciones clínicamente relevantes.1

6. Un diseño retrospectivo razonable

Si quisiéramos hacerlo con seriedad, el retrospectivo local debería organizarse en al menos dos capas:

- calibración local: para explorar umbrales, definir escenarios de trabajo y comprobar si el flujo parece razonable;

- conjunto bloqueado de prueba local: que no se use para ajustar umbrales ni decidir retrospectivamente el mejor cuento posible.

Ese segundo punto es importante. Aunque el modelo no haya entrenado con la colección local, si nosotros usamos todo el retrospectivo para tunear umbrales y luego proclamamos rendimiento final sobre el mismo conjunto, volvemos a contaminar la evaluación.

Y aquí conviene añadir otra cautela: no todos los hospitales van a poder construir el mismo retrospectivo ni con el mismo nivel de verdad clínica. Eso obliga a distinguir entre:

- retrospectivos muy ricos, con biopsia y seguimiento razonables;

- retrospectivos parciales, útiles para algunas preguntas pero no para todas;

- y retrospectivos pobres, donde quizá solo podemos evaluar concordancia de lectura o carga, pero no seguridad clínica completa.

7. Flujos de lectura a simular

En mamografía de cribado no hay una sola forma de integrar IA. Y ahí está una parte muy rica de este caso. Lo interesante es simular varios flujos posibles:

- IA como filtro de muy bajo riesgo: ciertos estudios podrían no pasar a segunda lectura o pasar a una lectura humana simplificada;

- IA como lector complementario: el radiólogo mantiene la lectura, pero la IA ayuda a priorizar o arbitrar;

- IA como triage: los casos muy bajos o muy altos se separan, y los intermedios conservan el circuito intensivo de lectura humana.

La literatura retrospectiva reciente muestra precisamente que el lugar donde se inserta la IA en el flujo cambia de forma clínicamente relevante la sensibilidad, el recall y la carga.4

8. Variables de evaluación

Si el objetivo declarado es reducir carga sin perder calidad, yo mediría al menos:

- sensibilidad global;

- especificidad;

- recall rate;

- PPV de biopsia o de derivación, según circuito;

- número de estudios retirados de lectura completa;

- impacto sobre arbitraje;

- falsos negativos por densidad, edad, equipo o centro;

- y, si existe seguimiento suficiente, cánceres de intervalo.

Eso permite algo importante: separar un ahorro aparente de trabajo de un deterioro silencioso del programa.

9. Implantación local y costes

Este es probablemente el punto más fácil de olvidar cuando uno mira solo papers o demos.

Implantar una IA en mamografía no es conectar una caja negra y esperar que el servicio respire mejor al día siguiente. Hace falta trabajo clínico, técnico y organizativo:

- acordar el uso previsto real del sistema en el hospital;

- decidir quién autoriza el acceso al retrospectivo y con qué reglas;

- anonimizar o pseudonimizar con garantías;

- reconstruir vínculos entre imagen, BI-RADS, biopsia y seguimiento;

- separar conjuntos de calibración y prueba;

- pactar umbrales y criterios de no inferioridad;

- integrar la salida del modelo en el flujo de lectura sin volverlo ilegible;

- formar a radiólogos y técnicos;

- y preparar métricas de vigilancia que tengan sentido clínico.

Además, casi siempre aparecen costes que no salen en la promesa inicial del proveedor:

- tiempo de físicos, radiólogos e informáticos;

- almacenamiento y extracción de datos;

- QA del pipeline;

- soporte IT;

- revisión de casos discordantes;

- arbitraje extra durante fases de validación;

- y documentación para comités, calidad o dirección.

Una buena parte del coste real de implantar IA no está en la inferencia del modelo. Está en convertir un entorno hospitalario heterogéneo en un lugar donde ese modelo pueda ser evaluado sin autoengaño.

10. Qué valida realmente este diseño

Este caso no es un ataque a la IA. Al contrario. Es la forma seria de tomársela en serio.

Un buen despliegue local no consiste en comprar un algoritmo y confiar en la cifra media del folleto. Consiste en preguntarse:

- si el retrospectivo local es verdaderamente independiente del entrenamiento;

- si el flujo propuesto conserva la sensibilidad que el programa puede tolerar;

- si el ahorro de carga compensa;

- y si el rendimiento aguanta en los subgrupos que realmente importan.

Después de eso, lo sensato sería una fase prospectiva en modo sombra antes de cambiar el flujo real. Primero se observa, luego se calibra con prudencia y solo después se decide si la IA merece tocar el circuito vivo.

11. Control continuo y nuevas versiones

Incluso después de desplegar el sistema, el caso no se cierra. Si cambian:

- la versión del modelo;

- los equipos de mamografía;

- la mezcla entre 2D y DBT;

- la población atendida;

- el protocolo de lectura;

- o la política de recalls,

el rendimiento puede moverse.

Por eso un hospital serio necesita también algún tipo de control continuo:

- cohortes de validación ajenas al entrenamiento;

- auditorías periódicas de falsos negativos y recalls;

- revisión de subgrupos difíciles;

- comprobación de que las nuevas versiones del modelo mantienen calidad;

- y capacidad para frenar o corregir si el rendimiento local deriva.

La IA clínica se parece más a un proceso de calidad sostenida que a la compra aislada de una licencia.

Para ampliar

- FDA - Guiding Principles: Good Machine Learning Practice

- PubMed - Artificial intelligence for breast cancer screening: BreastScreen population-based cohort study of cancer detection

- PubMed - AI-integrated Screening to Replace Double Reading of Mammograms: A Population-wide Accuracy and Feasibility Study

- PubMed - Influence of Mammography Acquisition Parameters on AI and Radiologist Interpretive Performance

-

La FDA subraya en GMLP la independencia entre entrenamiento y test, la representatividad del conjunto, el análisis de factores de paciente, adquisición y sitio, y el rendimiento del equipo humano-IA en condiciones de uso clínicamente relevantes. ↩︎ ↩︎

-

El estudio BreastScreen usa una validación externa retrospectiva sobre una cohorte poblacional real con seguimiento e ilustra bien cómo el rendimiento y la carga cambian cuando se simulan flujos de lectura con IA. ↩︎

-

El trabajo sobre parámetros de adquisición recuerda además que la performance de IA y radiólogos puede cambiar con condiciones técnicas que en un despliegue local no son neutrales. ↩︎

-

El estudio poblacional sobre sustitución de doble lectura muestra precisamente que el punto exacto del flujo donde se inserta la IA altera sensibilidad, PPV, arbitraje y volumen de lectura. ↩︎