Visualización y procesamiento de imagen

Una imagen médica no termina cuando se adquiere. A partir de ese punto entra en una cadena de visualización, procesamiento, cuantificación, comunicación clínica y trazabilidad.

Primero aparece el dato bruto o el volumen reconstruido. Después intervienen decisiones sobre visualización, selección de contraste, cuantificación, registro, segmentación, fusión, representación geométrica, exportación y conservación dentro del proceso asistencial. Cada una de esas etapas modifica lo que puede verse, medirse o decidirse clínicamente, y no todas conservan la misma información ni la misma trazabilidad.

Conviene separar dos conceptos:

- visualización, es decir, cómo se presenta el dato para hacerlo interpretable por un observador humano;

- procesamiento, es decir, cómo se transforma el dato en objetos, medidas, registros, máscaras, superficies o descriptores útiles para una tarea clínica o investigadora.

Ambos planos están conectados, pero no son equivalentes. La visualización condiciona la percepción y la decisión humana. El procesamiento condiciona qué objetos clínicos pueden derivarse del dato.

1. Visualización como parte del proceso clínico

La visualización no es una etapa decorativa. Determina qué información puede percibir un observador y con qué fiabilidad puede usarla en contexto clínico.

Además, no todos los usuarios observan la misma imagen con el mismo objetivo. Cambia el punto de vista según el rol:

- el radiólogo busca contraste útil, patrones, relaciones anatómicas y hallazgos diagnósticos;

- el oncólogo radioterápico necesita volúmenes, límites anatómicos, relación con órganos de riesgo y consistencia espacial para delineación;

- el cirujano o el intervencionista pueden requerir superficies, trayectorias, relaciones espaciales y vistas orientadas a planificación operatoria;

- el patólogo digital necesita color, textura, escala local y navegación a muy alta resolución;

- el físico médico verifica consistencia geométrica, trazabilidad, rangos de intensidad, calibración y estabilidad del pipeline.

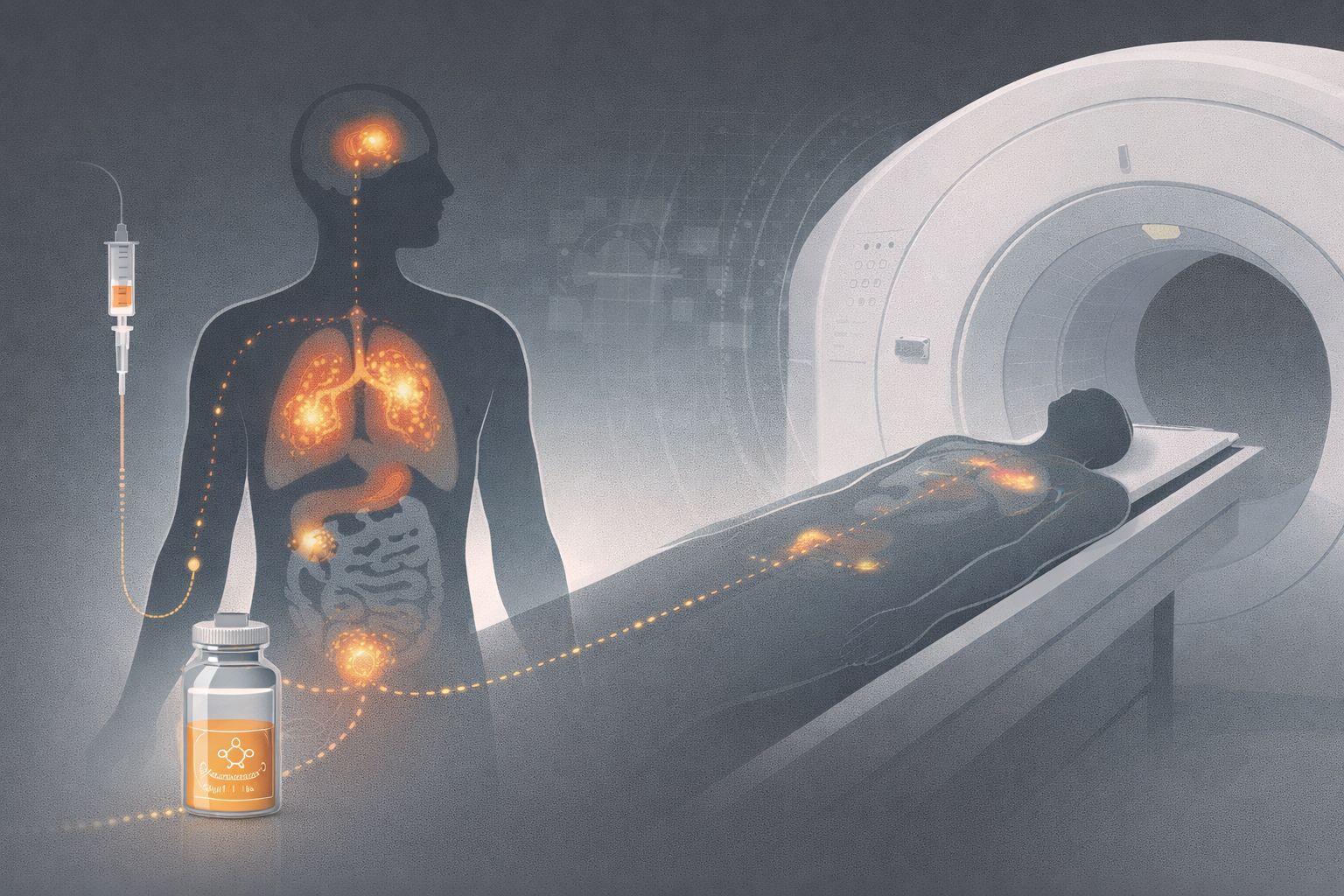

Esto implica que una misma adquisición puede requerir presentaciones distintas según la tarea. En TAC, por ejemplo, no se visualiza igual una ventana de pulmón que una de mediastino o hueso. En PET-TAC, la información funcional y anatómica se presentan de forma distinta según el objetivo sea diagnóstico, cuantificación o delineación. En radioterapia, la visualización no es solo lectura: forma parte de la planificación.

También conviene distinguir entre visualización in vivo y visualización diferida. En ecografía, fluoroscopia o navegación intraoperatoria, la visualización interviene en tiempo real sobre la acción clínica. En radiología diagnóstica, la lectura suele ser diferida pero sigue dependiendo del modo de presentación.

2. Escala de grises, color y fusión

La presentación visual de una imagen médica está limitada por fisiología visual, tecnología de visualización y decisiones de mapeo entre dato e intensidad visible.

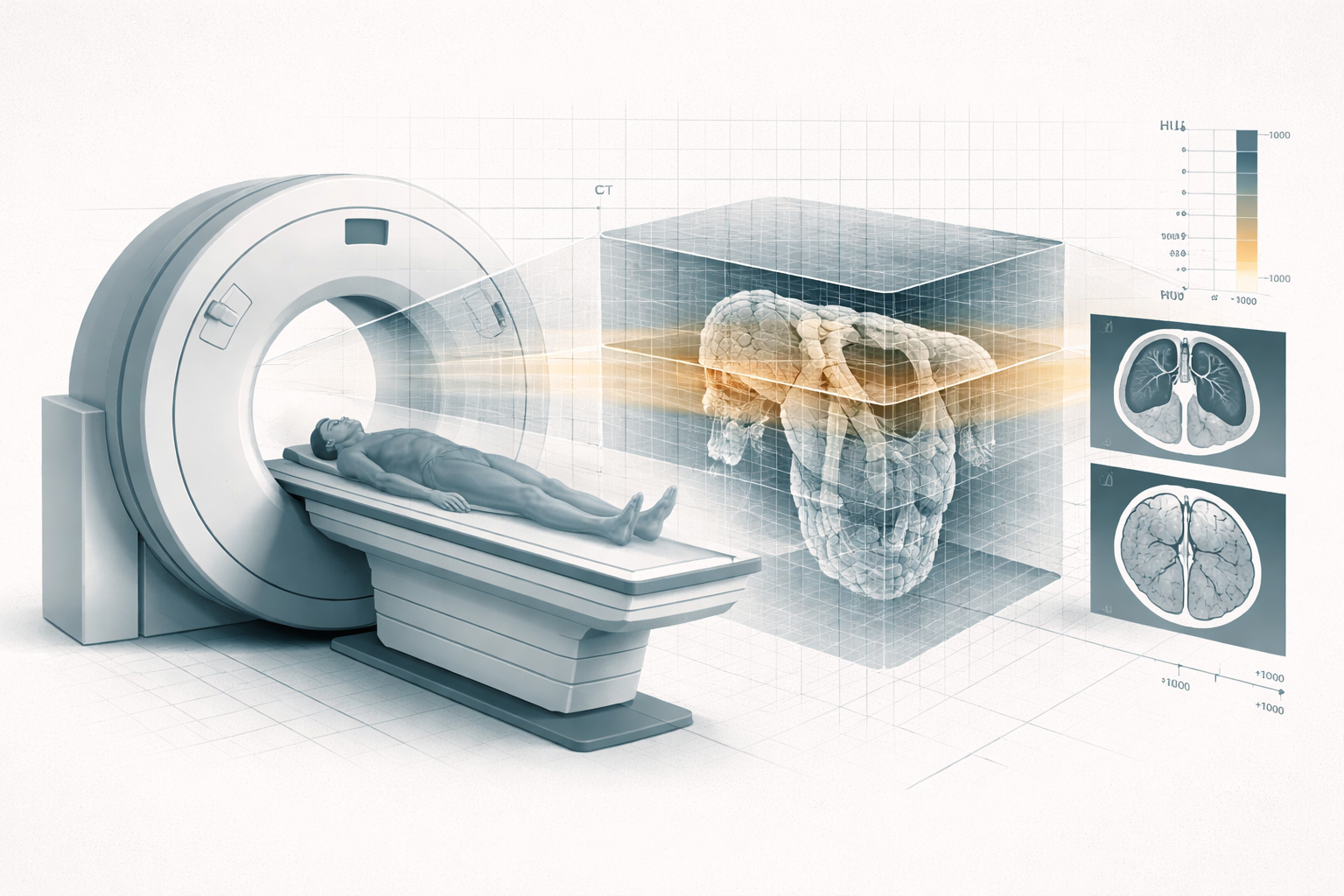

Escala de grises, windowing y rango dinámico

Muchas modalidades médicas generan datos con profundidad superior a la que puede representarse simultáneamente en pantalla o discriminarse de forma útil por el sistema visual humano. Es frecuente trabajar con imágenes de 12 a 16 bits por píxel, mientras que la presentación visible suele resolverse en 8 bits por canal o en un rango perceptualmente mucho más estrecho para observación inmediata.

Por eso el windowing no es un ajuste cosmético. Es un mapeo entre un rango de intensidades del dato y un rango de salida visible. Seleccionar ventana y nivel equivale a decidir qué información entra en el espacio perceptual útil del observador.

En radiología diagnóstica esto es crítico. En TAC, la misma adquisición puede hacerse prácticamente ilegible para pulmón, mediastino o hueso si la ventana no es la adecuada. En visualización de RM, el contraste también depende del escalado y de la forma en que se presenta la señal.

El observador no ve el dato original, sino una transformación del mismo condicionada por windowing, escala, dispositivo de visualización y contexto clínico.

Percepción, presentación y estándares

La presentación no depende solo del dato. También depende de la respuesta perceptual del observador y de la consistencia del dispositivo de visualización. DICOM incluye perfiles y funciones de presentación destinados a mantener consistencia perceptual entre estaciones, monitores y contextos de visualización. Esto no convierte la percepción en algo completamente controlable, pero recuerda que la visualización médica requiere estandarización además de procesado.

Mapas de color

El color puede ser útil cuando codifica una variable adicional o ayuda a separar información superpuesta. Puede representar perfusión, captación, funcionalidad, segmentación, probabilidad, temperatura, elasticidad o etiquetas anatómicas. Sin embargo, un mal mapa de color puede exagerar diferencias leves, inducir discontinuidades perceptuales artificiales o sugerir relevancia clínica donde solo hay una gradación técnica.

Fusión multimodal

La fusión visual se vuelve especialmente relevante cuando se combinan modalidades complementarias. En PET-TAC, por ejemplo, el TAC aporta geometría anatómica y el PET aporta distribución funcional o metabólica. El color no es un adorno en este contexto: sirve para superponer una variable funcional sobre una referencia anatómica. En planificación radioterápica, la fusión entre TAC, RM y PET puede condicionar delineación de volúmenes y relación con órganos de riesgo.

3. Superficies, volumen y renderizado

Cuando el dato pasa de proyección o corte a representación tridimensional, aparecen varias estrategias de visualización con finalidades diferentes.

Superficies

A partir de una segmentación, un umbral o una malla derivada, puede generarse una superficie cerrada de una estructura anatómica o patológica. Esto resulta útil para planificación operatoria, impresión 3D, comunicación con clínicos no radiólogos y mediciones geométricas intuitivas.

Sin embargo, una superficie es siempre un objeto derivado. Depende de segmentación, interpolación, resolución, suavizado y mallado. No debe confundirse con la anatomía original.

Una representación tridimensional puede resultar más intuitiva sin ser más fiel al dato original.

Renderizado volumétrico

El volume rendering mantiene la naturaleza volumétrica del dato y evita la necesidad de cerrar estructuras en superficies explícitas. Técnicas como ray casting permiten asignar opacidad y color según intensidad o funciones de transferencia. Esto puede ser útil para navegación anatómica, docencia, revisión clínica o planificación.

Visualización orientada a tarea

No existe una visualización única óptima. Una misma adquisición puede requerir:

- visualización diagnóstica;

- visualización para delineación radioterápica;

- visualización operatoria;

- visualización para docencia o discusión multidisciplinar;

- o visualización para extracción de medidas.

La elección de representación depende de la tarea, no solo de la estética del renderizado.

4. Objetos clínicos derivados de la imagen

Si la visualización decide cómo se presenta el dato, el procesamiento decide qué objetos clínicos pueden derivarse de él.

La pregunta central no es qué algoritmo resulta más llamativo, sino qué salida necesita la tarea clínica o investigadora. Entre los objetos más frecuentes están:

- segmentaciones;

- registros;

- medidas geométricas o volumétricas;

- curvas temporales;

- mapas paramétricos;

- características radiómicas;

- superficies;

- y verificaciones de consistencia espacial entre estudios o modalidades.

En radioterapia esto se traduce en volúmenes tratables, órganos de riesgo, estructuras fusionadas y objetos utilizables en planificación. En planificación operatoria puede traducirse en trayectorias, relaciones espaciales o superficies anatómicas. En investigación puede traducirse en biomarcadores cuantificables.

5. Segmentación y definición de estructuras

La segmentación es uno de los grandes ejes del procesamiento de imagen médica. Consiste en separar una estructura de interés del resto del volumen o de la imagen.

Puede ser:

- manual;

- semiautomática;

- automática clásica;

- o aprendida por modelos de IA.

Y puede perseguir objetivos muy distintos:

- delimitar tumor;

- definir órganos de riesgo;

- medir cavidades o volúmenes;

- extraer superficies;

- crear datos de entrenamiento;

- o cuantificar cambios longitudinales.

En teoría parece sencillo: dibujar el órgano. En la práctica casi nunca lo es. Las fronteras pueden ser borrosas, el contraste puede ser pobre, el tejido puede estar deformado por tratamiento o enfermedad y el observador puede tener dudas perfectamente legítimas sobre dónde termina realmente una estructura.

Por eso la segmentación no es solo un problema computacional. Es un problema anatómico, clínico, geométrico y epistemológico.

Caso guiado: CAD y segmentación con aceptación clínica Un ejemplo donde el clínico conserva la aceptación final y el riesgo se desplaza hacia la revisión, la corrección y el modo real de integrar la herramienta.6. Extracción de rasgos y cuantificación

Una vez segmentada o localizada una región, empieza otra familia de tareas: la extracción de características.

Aquí entran:

- volumen;

- superficie;

- esfericidad;

- elongación;

- intensidades medias o extremas;

- heterogeneidad;

- texturas;

- bordes;

- relaciones espaciales;

- y muchos otros descriptores.

Esto vale para radiología, RM, PET e imagen tisular. Y es justo donde la imagen deja de ser solo interpretación visual y pasa a ser también cuantificación.

El problema es que esa cuantificación hereda todo lo anterior. Si la adquisición cambia, si la segmentación no es estable, si el registro es débil o si el paciente es anatómicamente singular, los números dejan de parecer tan sólidos como prometían.

Además, la propia definición de la variable (por ejemplo, qué se considera borde, volumen o intensidad relevante) introduce variabilidad adicional.

7. Registro rígido y deformable

El registro intenta alinear imágenes o estructuras en un mismo marco espacial. Y aquí hay dos grandes familias que conviene no confundir.

Registro rígido

Supone que basta con traslaciones y rotaciones, a veces con escalado o transformaciones afines. Es útil cuando la anatomía se conserva razonablemente o cuando la pregunta tolera una simplificación geométrica fuerte.

Registro deformable

Asume que la anatomía cambia de forma local y que no basta con mover bloques rígidos. Aquí entran respiración, llenado vesical, compresión, cirugía previa, deformación tumoral, diferencias de posicionamiento, cambios entre modalidades o incluso evolución de enfermedad.

Esto es crucial en:

- tórax y movimiento respiratorio;

- corazón, donde el problema ya es casi intrínsecamente dinámico;

- pelvis, donde vejiga y recto cambian mucho;

- radioterapia, donde alinear no es solo comparar, sino también tratar;

- y estudios longitudinales donde la anatomía real no coincide necesariamente con la representación previa.

8. Variabilidad anatómica y casos complejos

Aquí aparece una parte especialmente importante que muchas presentaciones técnicas olvidan: los pacientes no siempre obedecen al atlas.

Hay:

- anatomías deformadas por cirugía;

- prótesis y metal;

- tumores que desplazan estructuras;

- malformaciones;

- pacientes con gran asimetría;

- alteraciones posicionales;

- órganos móviles;

- y casos raros, como situs inversus o disposiciones anatómicas que rompen supuestos de lateralidad y quiralidad.

Todo eso introduce complejidad real en segmentación, registro, extracción de superficies y cuantificación. Un algoritmo que funciona bien en el caso promedio puede degradarse precisamente en los pacientes donde más hace falta estabilidad.

Esa es una lección importante: el procesamiento de imagen no falla solo por mal código. Falla también porque la biología real no se deja idealizar del todo.

9. Repetibilidad, reproducibilidad y proceso clínico

En investigación se habla mucho de reproducibilidad. En clínica, además, hace falta repetibilidad útil y trazabilidad operativa.

No basta con que una herramienta funcione una vez en una demostración controlada. Tiene que comportarse de forma estable en pacientes distintos, tolerar variaciones razonables de protocolo, integrarse en el flujo clínico y generar resultados suficientemente consistentes como para apoyar decisiones.

Ese es uno de los grandes filtros entre software interesante y software realmente utilizable.

Una segmentación espectacular que nadie puede revisar ni repetir sirve de poco. Un registro deformable muy sofisticado pero imposible de auditar también. Una visualización brillante que no encaja en PACS (picture archiving and communication system) o no puede compararse con estudios previos queda rápidamente aislada.

10. Software y flujo clínico

El ecosistema de software es amplio y conviene organizarlo por funciones dentro del flujo clínico y técnico.

Las herramientas no definen el problema. Son implementaciones concretas de necesidades de visualización, procesamiento y gestión dentro del sistema clínico.

No se trata de un catálogo cerrado, sino de un mapa de familias de herramientas que permiten visualizar, segmentar, registrar, cuantificar, integrar, archivar y desplegar imagen médica en contextos clínicos e investigadores.

Visualización y plataformas de trabajo

- VTK es una de las grandes bases del renderizado científico y de la visualización 3D. Su propio sitio lo define como una herramienta abierta para manipular y mostrar datos científicos, con capacidades de renderizado 3D y plotting 2D.1

- 3D Slicer es probablemente una de las plataformas más completas para visualización, segmentación, registro y análisis en 2D/3D/4D. Su documentación y su web oficial dejan muy claro que no es solo un visor, sino una plataforma de image computing con módulos, extensiones y scripting.234

- OHIF cubre muy bien la capa web: visualización, anotación, segmentación, fusión, volumen, 4D y flujos basados en DICOMweb dentro del navegador.5

Librerías de procesamiento general

- ITK sigue siendo una de las bases históricas para segmentación y registro en imagen médica.

- SimpleITK simplifica mucho el acceso a ese ecosistema y, según su propia documentación, ofrece registro rígido y deformable, filtros de segmentación y análisis de forma, todo ello tratando las imágenes como objetos espaciales y no meros arrays.6

- scikit-image y OpenCV son muy útiles para tareas generales de filtrado, morfología, geometría y prototipado, aunque no nacieran exclusivamente para medicina.

- pydicom y pynetdicom son especialmente valiosos cuando el problema no es solo procesar, sino leer, escribir o mover DICOM dentro de pipelines más grandes.7

- DCMTK aporta una capa muy valiosa cuando hace falta trabajar con el ecosistema DICOM a bajo nivel y con herramientas maduras de línea de comandos, red, almacenamiento y validación. En muchos entornos sigue siendo una base silenciosa pero decisiva para pruebas, integración y operación.8

- Orthanc representa muy bien la idea de infraestructura ligera y programable: un servidor DICOM/PACS minimalista, con API (

application programming interface) REST (representational state transfer) y plugins, muy útil para investigación, integración, prototipos clínicos y despliegues controlados donde el archivo y el acceso importan tanto como el algoritmo.9

Registro especializado

- elastix se presenta oficialmente como una caja de herramientas abierta para registro rígido y no rígido, basada en ITK y pensada para configurar y comparar métodos de registro mediante scripting.10

- SimpleElastix e ITKElastix acercan ese mundo a Python y a flujos más ágiles.

- ANTs / ANTsX son referencia fuerte en registro y análisis biomédico multimodal, con un ecosistema que se ha extendido a Python, R y deep learning.11

- BRAINSFit, muy visible en Slicer, es un ejemplo estupendo de herramienta especializada que mucha gente asocia especialmente a cerebro y a flujos donde el alineamiento anatómico fino importa mucho.4

Segmentación y cuantificación

- 3D Slicer Segment Editor ofrece edición manual, semiautomática y automática, además de estadísticas geométricas y conversión entre representaciones.312

- ITK-SNAP sigue siendo una herramienta muy querida precisamente porque mantiene un foco claro en segmentar estructuras en imágenes 3D y 4D, con semi-automatización y un interfaz bastante manejable.13

- FreeSurfer representa bien el caso de ecosistemas muy especializados por órgano o dominio: cerebro, superficies corticales, segmentación anatómica, morfometría, longitudinalidad.14

Deep learning y anotación asistida

- TensorFlow y Keras han sido durante años una vía muy natural para construir segmentadores, con tutoriales oficiales de segmentación basados en U-Net.15

- MONAI es probablemente la referencia más claramente médica dentro del mundo de IA sobre PyTorch, con un ecosistema orientado a entrenamiento, despliegue y consistencia clínica.16

- MONAI Label va un paso más allá: se centra en etiquetado asistido por IA e integración con flujos clínicos y herramientas como 3D Slicer, OHIF o QuPath.17

- TorchIO es especialmente útil para carga, preprocesado, augmentación y muestreo por parches en imagen médica 3D.18

Imagen tisular y patología digital

- QuPath es una referencia clarísima en bioimagen y patología digital, con foco en whole-slide imaging, anotación, clasificación e integración con otros entornos.19

- OpenSlide resuelve una parte básica pero decisiva: lectura de whole-slide images o virtual slides desde una librería C sencilla y estable.20

- Fiji / ImageJ sigue siendo un ecosistema enorme para segmentación, registro, color, scripting y análisis científico de imagen visible.21

Despliegue, contenedores y cloud

Hay una capa que a veces no se ve en las demos, pero que en cuanto un prototipo quiere sobrevivir fuera del portátil se vuelve central: cómo se despliega.

- Docker ha cambiado mucho el trabajo diario porque permite empaquetar librerías, modelos, dependencias y servicios de visualización o procesado de forma reproducible. En investigación acelera pruebas; en clínica o preclínica ayuda a fijar versiones, reducir “en mi máquina funcionaba” y dejar pipelines mejor trazados.22

- Kubernetes aparece cuando el problema deja de ser lanzar un contenedor aislado y pasa a ser orquestar servicios, colas, escalado, disponibilidad y despliegues repetibles en entornos grandes o distribuidos.23

- La cloud entra aquí no solo como palabra de moda, sino como forma de resolver almacenamiento, computación, acceso distribuido, despliegue web y procesamiento intensivo, especialmente cuando hablamos de whole-slide imaging, series 3D/4D, entrenamiento de modelos o colaboración entre centros.

Eso sí, en imagen médica la nube no es solo comodidad. También abre preguntas mucho más serias sobre:

- gobernanza del dato;

- latencia;

- costes sostenidos;

- ciberseguridad;

- cumplimiento normativo;

- y soberanía de la información clínica.

Por eso, muchas veces, el ecosistema real termina siendo híbrido: parte on-premise, parte cloud, con PACS clásicos, servidores DICOM ligeros, visores web y pipelines de análisis que viven repartidos entre varias capas.

11. Perfiles de usuario

No todos los usuarios interactúan con la imagen del mismo modo ni con el mismo objetivo.

- Hay usuarios que necesitan visualizar y revisar.

- Otros necesitan anotar o segmentar.

- Otros construir pipelines reproducibles.

- Otros entrenar modelos.

- Otros integrar archivo, visualización y trazabilidad dentro de un flujo clínico mayor.

Tampoco observa lo mismo un radiólogo que un cirujano, un patólogo digital, un oncólogo radioterápico o un físico médico. Cambian la pregunta, la representación útil, la necesidad de medida y el nivel de tolerancia a incertidumbre geométrica.

Parte del reto real consiste en encadenar herramientas de distinto nivel sin romper trazabilidad, usabilidad ni coherencia clínica.

12. Relación entre dato, modelo y decisión

La adquisición produce un dato. La visualización lo vuelve legible. El procesamiento lo vuelve operable. La cuantificación lo vuelve comparable. Y la clínica decide si todo eso es suficiente para actuar.

Visualizar y procesar no son tareas secundarias. Forman parte del corazón mismo de la imagen médica moderna.

Este campo obliga a integrar física, matemáticas, software, percepción, anatomía, singularidad del paciente, criterios clínicos y responsabilidad organizativa en una misma cadena.

Ninguna librería, visor o algoritmo por separado agota ese problema.

Relacionado

Para ampliar

Si alguien quisiera entrar en este ecosistema sin perderse, una guía rápida y bastante razonable podría ser esta:

- Para visualizar, segmentar y probar flujos clínicos sin programar demasiado: 3D Slicer, 3D Slicer - Image Segmentation, 3D Slicer - Segment Editor, 3D Slicer - Registration / BRAINSFit, ITK-SNAP y OHIF Viewer.

- Para entender la base algorítmica de segmentación, registro y tratamiento de imagen: ITK, SimpleITK, elastix, ANTsX, scikit-image y OpenCV.

- Para renderizado, volumen y visualización 3D: VTK. Muchas herramientas más altas de nivel se apoyan, de una forma u otra, en esa capa.

- Para cerebro y dominios muy especializados: FreeSurfer sigue siendo referencia clara en neuroimagen estructural.

- Para deep learning médico y pipelines de IA: TensorFlow - Image segmentation tutorial, MONAI, MONAI Label y TorchIO. Aquí la pregunta no es solo “cómo entrenar”, sino cómo conectar entrenamiento, anotación y despliegue.

- Para patología digital e imagen tisular: QuPath, OpenSlide y Fiji. Son una puerta muy natural si el problema ya no es radiológico sino de whole-slide imaging, color y anotación de tejido.

- Para DICOM, archivo y capa operativa de sistemas: pydicom, DCMTK y Orthanc. Aquí ya no se trata solo de ver o segmentar, sino de leer, mover, servir, validar y archivar imagen médica real.

- Para despliegue reproducible y servicios escalables: Docker y Kubernetes. No son librerías de imagen, pero sí parte importante del mundo donde estas herramientas acaban viviendo.

-

VTK, “The Visualization Toolkit is open source software for manipulating and displaying scientific data… with tools for 3D rendering.” https://vtk.org/ ↩︎

-

3D Slicer official site describes Slicer as free, open-source software for visualization, processing, segmentation, registration, and analysis of 3D images and meshes. https://www.slicer.org/ ↩︎

-

3D Slicer documentation, “Image Segmentation”. https://slicer.readthedocs.io/en/latest/user_guide/image_segmentation.html ↩︎ ↩︎

-

3D Slicer registration documentation includes BRAINSFit and specialized registration modules. https://www.slicer.org/wiki/Documentation/4.4/Modules/Registration ↩︎ ↩︎

-

OHIF docs describe the OHIF Viewer as an open-source, web-based medical imaging platform with segmentation, fusion, volume rendering, microscopy and 4D support. https://docs.ohif.org/ ↩︎

-

SimpleITK official site highlights registration, segmentation workflows and image analysis in physical space. https://simpleitk.org/ ↩︎

-

Pydicom describes DICOM as central to medical image datasets, storage and transfer, with pydicom and pynetdicom supporting dataset handling and networking. https://pydicom.github.io/ ↩︎

-

DCMTK is presented by OFFIS as a collection of libraries and applications implementing large parts of the DICOM standard for examining, constructing and converting DICOM files, handling storage media, and supporting network communication. https://dcmtk.org/ ↩︎

-

Orthanc describes itself as a lightweight, RESTful vendor-neutral archive for medical imaging that can serve as a programmable DICOM server and mini-PACS. https://www.orthanc-server.com/ ↩︎

-

elastix official site: toolbox for rigid and nonrigid registration, based on ITK. https://elastix.dev/ ↩︎

-

ANTsX GitHub organization describes itself as an ecosystem supporting multi-modality biomedical image analysis across programming languages. https://github.com/ANTsX ↩︎

-

3D Slicer documentation, “Segment Editor” for 2D/3D/4D images. https://slicer.readthedocs.io/en/5.8/user_guide/modules/segmenteditor.html ↩︎

-

ITK-SNAP official site describes it as free, open-source software used to segment structures in 3D and 4D biomedical images, with semi-automatic segmentation and manual delineation. https://www.itksnap.org/ ↩︎

-

FreeSurfer official site describes it as an open-source neuroimaging toolkit for processing, analyzing and visualizing human brain MR images. https://freesurfer.net/ ↩︎

-

TensorFlow official segmentation tutorial. https://www.tensorflow.org/tutorials/images/segmentation ↩︎

-

MONAI official site. https://monai.io/ ↩︎

-

MONAI Label official site describes AI-assisted image labeling with integration into Slicer, OHIF and pathology workflows. https://monai.io/label.html ↩︎

-

TorchIO documentation describes the library as an open-source Python library for loading, preprocessing, augmentation and patch-based sampling of 3D medical images in deep learning. https://docs.torchio.org/ ↩︎

-

QuPath official site and docs. https://qupath.github.io/ ↩︎

-

OpenSlide API docs describe it as a C library providing a simple interface to read whole-slide images. https://openslide.org/api/ ↩︎

-

Fiji is described in ImageJ docs as a batteries-included distribution of ImageJ for scientific image analysis. https://imagej.net/software/fiji/ ↩︎

-

Docker describes itself as a platform to build, share and run applications in containers. https://www.docker.com/ ↩︎

-

Kubernetes documentation presents Kubernetes as an open-source system for automating deployment, scaling and management of containerized applications. https://kubernetes.io/ ↩︎